Tối ưu Token Caching: Giảm độ trễ cho ứng dụng AI

Published on Tháng 1 21, 2026 by Admin

Tại Sao Độ Trễ Lại Là Kẻ Thù Của Ứng Dụng?

Trong thế giới kỹ thuật số ngày nay, người dùng rất thiếu kiên nhẫn. Một vài giây chờ đợi cũng có thể khiến họ rời bỏ ứng dụng của bạn. Điều này đặc biệt đúng với các ứng dụng tương tác thời gian thực như chatbot AI, trợ lý lập trình hoặc các công cụ dịch thuật trực tiếp.Độ trễ cao làm gián đoạn luồng công việc của người dùng. Ví dụ, một chatbot trả lời chậm chạp sẽ tạo cảm giác thiếu tự nhiên và kém thông minh. Tương tự, một công cụ gợi ý code bị trễ sẽ làm giảm năng suất của lập trình viên. Vì vậy, giảm độ trễ không chỉ là một cải tiến kỹ thuật mà còn là một yếu tố kinh doanh quan trọng.

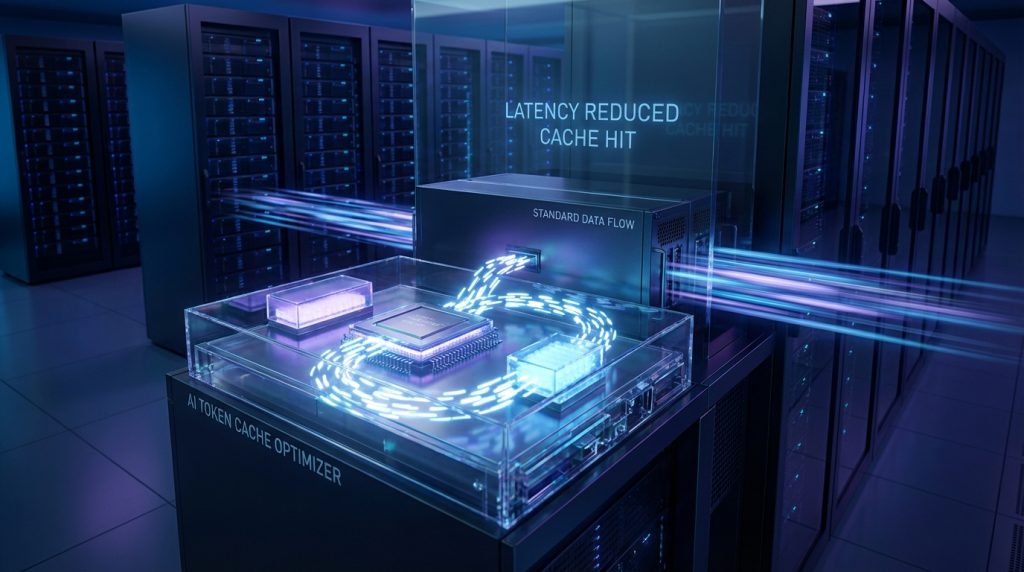

Token Caching Hoạt Động Như Thế Nào?

Để hiểu về token caching, trước tiên chúng ta cần biết token là gì. Trong xử lý ngôn ngữ tự nhiên (NLP), token là một đơn vị văn bản nhỏ nhất, có thể là một từ, một ký tự hoặc một phần của từ. Các mô hình ngôn ngữ lớn (LLM) xử lý và tạo ra văn bản dưới dạng một chuỗi các token.Token caching là quá trình lưu trữ tạm thời các token hoặc các kết quả tính toán liên quan đến token. Thay vì phải tạo lại hoặc xử lý lại các token giống nhau nhiều lần, hệ thống có thể lấy chúng trực tiếp từ bộ nhớ đệm (cache). Quá trình này nhanh hơn rất nhiều so với việc tính toán lại từ đầu.

Hãy tưởng tượng cache như một bộ nhớ ngắn hạn của con người. Thay vì phải suy nghĩ lại từ đầu về một thông tin quen thuộc, não bộ của chúng ta sẽ lấy nó ra từ trí nhớ một cách nhanh chóng. Token caching hoạt động theo nguyên tắc tương tự.

Các Chiến Lược Caching Token Hiệu Quả

Không có một giải pháp caching duy nhất phù hợp cho mọi trường hợp. Việc lựa chọn chiến lược phụ thuộc vào kiến trúc ứng dụng, yêu cầu về độ trễ và nguồn lực của bạn. Dưới đây là một số chiến lược phổ biến và hiệu quả.

Caching ở Phía Client (Client-Side Caching)

Caching phía client có nghĩa là lưu trữ dữ liệu trực tiếp trên thiết bị của người dùng, chẳng hạn như trong bộ nhớ của trình duyệt hoặc ứng dụng di động. Cách tiếp cận này rất hiệu quả để giảm các yêu cầu gửi đến máy chủ.Ưu điểm chính là tốc độ truy xuất cực nhanh vì dữ liệu đã có sẵn cục bộ. Ngoài ra, nó cũng giúp giảm tải cho máy chủ của bạn. Tuy nhiên, phương pháp này cũng có nhược điểm. Ví dụ, bạn sẽ có ít quyền kiểm soát hơn đối với việc làm mới dữ liệu và có thể gặp rủi ro bảo mật nếu lưu trữ thông tin nhạy cảm.

Caching ở Phía Máy Chủ (Server-Side Caching)

Đây là chiến lược phổ biến nhất, nơi bộ nhớ đệm được triển khai trên hạ tầng máy chủ của bạn. Bạn có thể sử dụng các giải pháp như Redis hoặc Memcached để tạo một lớp caching hiệu suất cao.Khi một yêu cầu đến, máy chủ sẽ kiểm tra cache trước tiên. Nếu dữ liệu có sẵn (cache hit), nó sẽ được trả về ngay lập tức. Nếu không (cache miss), máy chủ sẽ xử lý yêu cầu, sau đó lưu kết quả vào cache cho các lần sử dụng sau. Một kỹ thuật quan trọng trong caching phía máy chủ là quản lý KV Cache, giúp tăng tốc đáng kể quá trình sinh token của các mô hình LLM.

Caching Phân Tán (Distributed Caching)

Đối với các hệ thống quy mô lớn với lưu lượng truy cập cao, một máy chủ cache duy nhất có thể trở thành điểm nghẽn. Do đó, caching phân tán ra đời như một giải pháp. Chiến lược này liên quan đến việc chia sẻ bộ nhớ đệm trên nhiều máy chủ.Hệ thống caching phân tán giúp tăng khả năng mở rộng và độ tin cậy. Nếu một node cache gặp sự cố, các node khác vẫn có thể tiếp tục hoạt động. Điều này đảm bảo tính sẵn sàng cao cho ứng dụng của bạn.

Gộp Token (Token Batching)

Mặc dù không phải là một kỹ thuật caching truyền thống, gộp token lại có tác động lớn đến việc giảm độ trễ tổng thể. Thay vì xử lý từng yêu cầu token một cách riêng lẻ, bạn có thể nhóm nhiều yêu cầu lại và xử lý chúng trong một lô (batch).Phương pháp này giúp tận dụng tối đa khả năng xử lý song song của phần cứng như GPU. Kết quả là thông lượng (throughput) của hệ thống tăng lên và độ trễ trung bình cho mỗi yêu cầu giảm xuống. Việc giảm độ trễ với gộp token là một bí quyết quan trọng cho các nhà phát triển backend để tối ưu hóa hiệu suất.

Các Yếu Tố Cần Cân Nhắc Khi Caching

Triển khai caching không chỉ đơn giản là lưu và lấy dữ liệu. Bạn cần xem xét cẩn thận một số yếu tố để đảm bảo hệ thống hoạt động hiệu quả và an toàn.

Chính Sách Thu Hồi Cache (Cache Invalidation)

Dữ liệu trong cache có thể trở nên lỗi thời. Do đó, bạn cần có một chiến lược để xóa hoặc cập nhật chúng. Đây được gọi là chính sách thu hồi cache.Một số chính sách phổ biến bao gồm:

- Time-to-Live (TTL): Dữ liệu sẽ tự động bị xóa khỏi cache sau một khoảng thời gian nhất định.

- Least Recently Used (LRU): Khi cache đầy, hệ thống sẽ xóa dữ liệu ít được sử dụng nhất gần đây.

- Write-Through Caching: Dữ liệu được ghi đồng thời vào cả cache và cơ sở dữ liệu chính, đảm bảo tính nhất quán.

Vấn Đề Bảo Mật

Bảo mật là một yếu tố cực kỳ quan trọng, đặc biệt khi bạn lưu trữ các token xác thực (authentication tokens) hoặc dữ liệu nhạy cảm của người dùng. Hãy đảm bảo rằng bộ nhớ đệm của bạn được bảo vệ an toàn. Tuyệt đối không lưu trữ thông tin nhạy cảm ở phía client mà không mã hóa.

Tính Nhất Quán Của Dữ Liệu

Một thách thức lớn của caching là giữ cho dữ liệu trong cache luôn đồng bộ với nguồn dữ liệu chính. Một chính sách thu hồi cache không hợp lý có thể dẫn đến việc người dùng nhận được thông tin cũ hoặc không chính xác. Vì vậy, bạn cần cân bằng giữa hiệu suất và tính nhất quán của dữ liệu.

Câu Hỏi Thường Gặp (FAQ)

Nên sử dụng caching phía client hay phía server?

Câu trả lời phụ thuộc vào ứng dụng của bạn. Caching phía client rất tốt cho dữ liệu tĩnh hoặc ít thay đổi, giúp giảm tải cho server. Ngược lại, caching phía server cho bạn nhiều quyền kiểm soát hơn, phù hợp với dữ liệu động và cần tính nhất quán cao.

Thời gian sống (TTL) cho token cache nên là bao lâu?

Không có con số chính xác. TTL phụ thuộc vào tần suất dữ liệu của bạn thay đổi. Đối với dữ liệu thay đổi thường xuyên, TTL nên ngắn (vài phút). Đối với dữ liệu tĩnh, bạn có thể đặt TTL dài hơn (vài giờ hoặc thậm chí vài ngày).

Token caching có giúp giảm chi phí vận hành không?

Chắc chắn có. Bằng cách giảm số lượng yêu cầu cần xử lý lại từ đầu, caching giúp giảm tải cho CPU và GPU. Điều này trực tiếp dẫn đến việc tiết kiệm chi phí tài nguyên máy chủ, đặc biệt là trên các nền tảng đám mây tính phí theo mức sử dụng.

Tóm lại, token caching là một công cụ mạnh mẽ để giảm độ trễ và cải thiện trải nghiệm người dùng cho các ứng dụng AI. Bằng cách lựa chọn và triển khai chiến lược caching phù hợp, bạn không chỉ làm cho ứng dụng nhanh hơn mà còn tối ưu hóa được chi phí vận hành. Hãy bắt đầu thử nghiệm và tìm ra giải pháp tốt nhất cho hệ thống của mình.